56

- ELETTRONICA OGGI 433 - GENNAIO/FEBBRAIO 2014

DIGITAL

NEURONAL CHIP

meglio la distanza fra i dati risolven-

do la questione.

Per esempio, osservando una carota

gialla o verde si potrebbe essere

indotti a pensare a una zucchina

o a una banana ma i nostri neuro-

ni elaborano tutti insieme la figura

osservata fino a che la nostra base

dati memorizzata e la nostra intui-

zione non ci portano alla condizione

di riconoscere che si tratta proprio

di una carota anche se non è aran-

cione. Questo è pressappoco ciò che

avviene in una rete neuronale quan-

do i neuroni propagano l’incertezza

di riconoscimento in tutta la rete

fino a che non acquisiscono risposte

positive sufficienti per decidere qual

è la risposta più verosimile alla que-

stione posta ossia qual è l’immagine

fra tutte quelle memorizzate nell’in-

tera rete che riduce il più possibile

la sua distanza con l’immagine di

ingresso.

In pratica, se se considera ogni neurone come un’unità

di calcolo comparativa unita a una memoria con 256 dati,

allora all’arrivo di un dato in ingresso i primi neuroni ne

eseguiranno il confronto con i propri in memoria usando

una oppure entrambe le due metodologie oggi più diffuse

fra le applicazioni software di questo tipo. Innanzi tutto,

ciascuno calcolerà le 256 distanze fra il dato di ingresso e

ciascuno dei suoi 256 dati in memoria e poi può scegliere

semplicemente il dato in memoria che è a minima distanza

rispetto al dato in ingresso oppure può fare la media alge-

brica delle 256 distanze e scegliere il dato in memoria che

minimizza entrambe le sue due distanze rispetto al valore

medio e al valore del dato di ingresso.

La differenza è puramente applicativa dato che general-

mente il primo metodo è più rapido ma il secondo è più

preciso e comunque capita spesso che siano eseguiti

entrambi i calcoli.

A questo punto il neurone deve valutare se il risultato può

essere giudicato sufficientemente positivo altrimenti pro-

pagherà un messaggio in tutta la rete con il dato giunto al

suo ingresso e la miglior risposta che gli è stato possibile

calcolare. I neuroni circostanti ripeteranno il confronto

del dato di ingresso con i loro 256 dati in memoria con-

frontando la loro risposta con quella proposta e nel caso

sia migliore invieranno un messaggio di risposta che con-

sentirà al primo neurone di migliorare la propria decisio-

ne e permetterà a tutti i neuroni della rete di aggiornare

la loro base dati in memoria per essere più efficaci nelle

successive decisioni. Al contrario il processo si ripete

nella rete fino a che non viene trovato un risultato con-

siderato positivo oppure finché non scatta un algoritmo

di controllo che avvisa della mancanza di una risposta

adeguata e richiede all’esterno ulteriori informazioni per

poter proseguire.

Calcolo neuronale parallelo

La distribuzione dell’intelligenza in rete è il punto di

forza delle reti neuronali che sono capaci di condividere

una decisione insieme agli altri neuroni, ma un’altra loro

importante peculiarità è che possono decidere anche se la

base dati collettiva è incompleta e fornire la risposta che

più verosimilmente soddisfa i requisiti imposti.

Quando ciò si verifica i neuroni hanno l’occasione di

imparare a conoscere nuovi dati e migliorare la propria

base di conoscenza usando criteri di valutazione forniti

dagli amministratori e grazie a ciò evolvere per perfezio-

nare continuamente la capacità decisionale della rete.

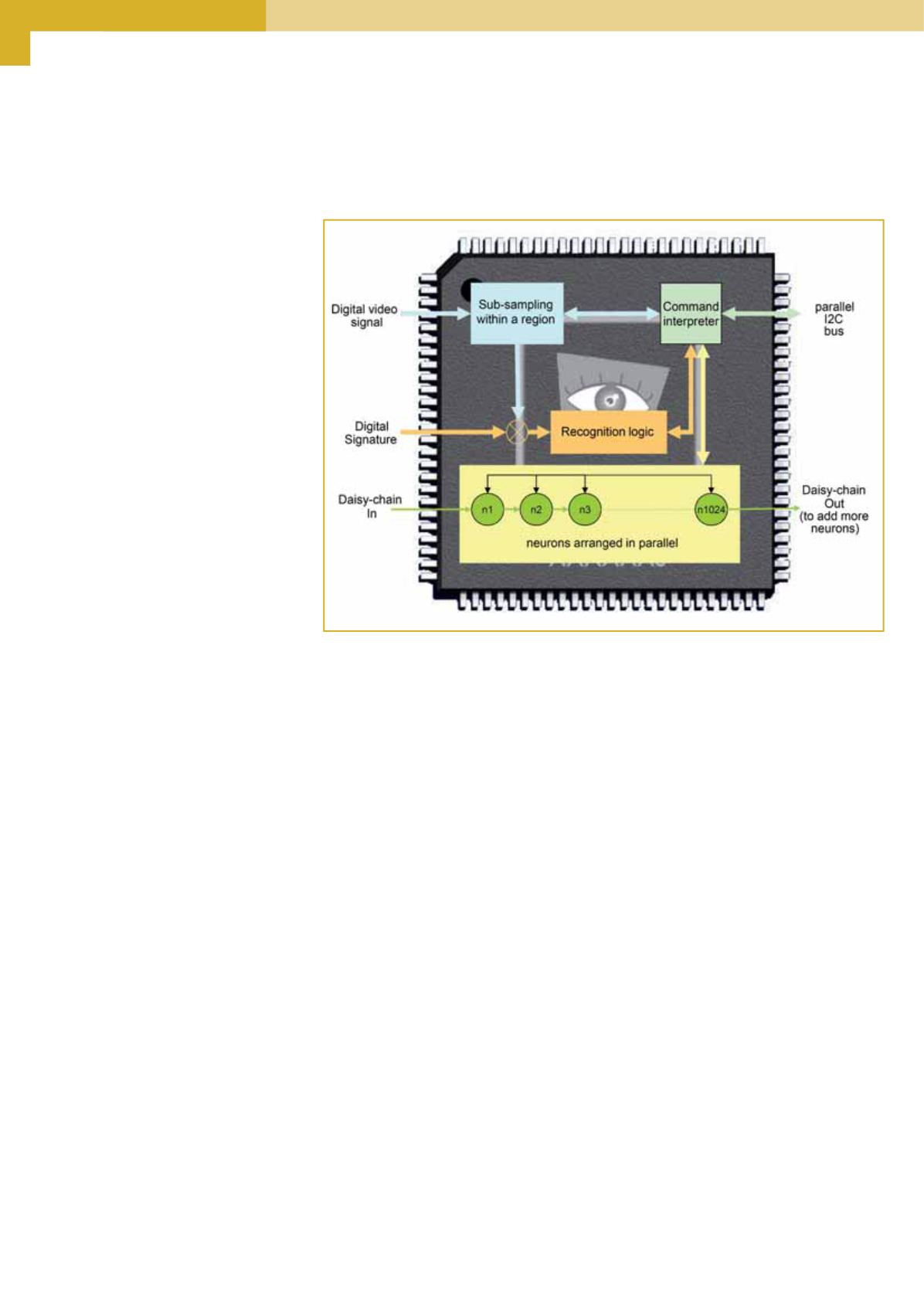

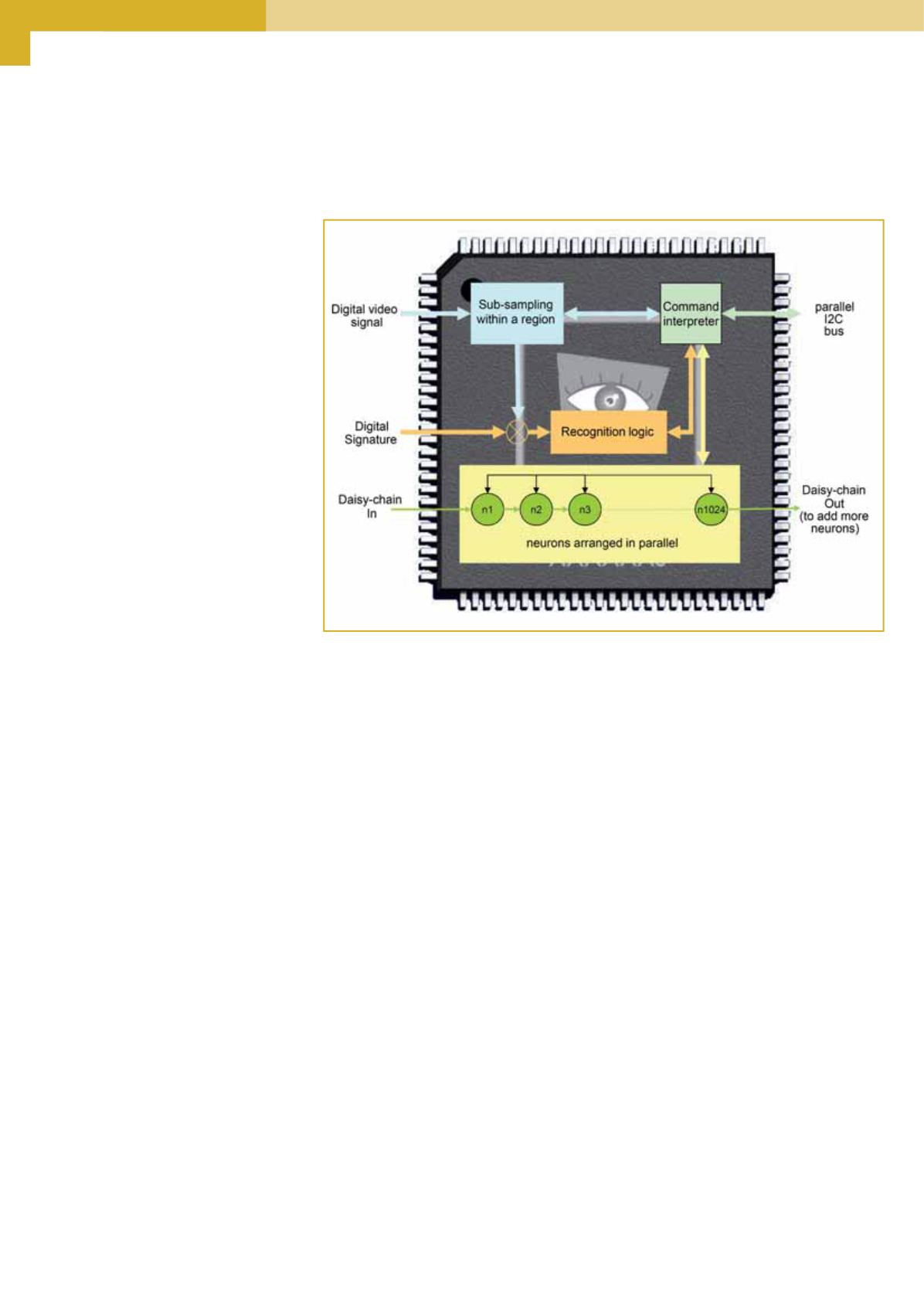

L’architettura dei chip CogniMem è concepita con due

motori logici non lineari che concorrono insieme all’anali-

si dei dati in ingresso, al raggiungimento della risposta più

plausibile e all’apprendimento necessario per il migliora-

mento della base di conoscenze della rete. Entrambi i

Fig. 2 – Nel CM1K l’intelligenza è distribuita fra tutti i neuroni nella rete e consente di ottenere un

rapporto fra prestazioni e consumi decine di volte migliore rispetto alle tecnologie basate su DSP